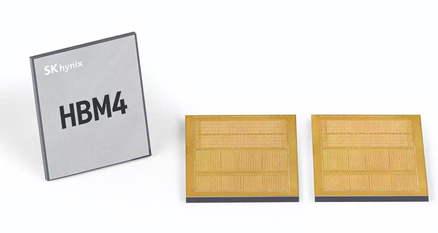

全球半导体行业迎来重大技术突破。2025年9月12日,SK海力士正式宣布已成功完成面向人工智能的超高性能存储器新产品HBM4的开发,并在全球首次构建了量产体系。这一里程碑式成就不仅巩固了SK海力士在AI存储器技术领域的领导地位,更将为下一代人工智能基础设施提供核心动力支撑。HBM4采用2048位接口设计,数据传输速度高达10 GT/s,超出JEDEC标准25%,实现了带宽翻倍和能效提升40%以上的显著突破。

01 技术突破:性能与能效的双重飞跃

SK海力士HBM4实现了令人瞩目的技术跨越。新一代内存采用了2048位接口,相比前代HBM3E的1024位接口翻倍,单颗内存带宽达到惊人的2.5TB/s。

在速度方面,HBM4运行速率达到10 GT/s(每秒10千兆比特),大幅超越JEDEC标准规定的8GT/s,超出标准要求25%。

能效提升同样显著。通过架构优化和工艺,HBM4能效比前代产品提升40% 以上,这将显著降低数据中心的电力消耗和运营成本。

02 量产准备:工艺确保稳定生产

SK海力士已经为HBM4的大规模生产做好充分准备。公司采用了自主研发的MR-MUF(批量回流模制底部填充)技术,这一技术在产品稳定性方面已获得市场认可。

在制造工艺上,HBM4采用了第五代10纳米级(1b)DRAM工艺,确保了量产过程的高可靠性和低风险。

MR-MUF技术通过在堆叠半导体芯片后填充液体保护材料并固化,有效保护芯片间电路。与传统薄膜型材料相比,该技术提高了效率和散热效果,特别是减少了芯片堆叠时所施加的压力,提高了芯片的翘曲控制力(Warpage Control),这是确保HBM稳定量产的关键。

03 应用前景:AI性能提升高达69%

HBM4的应用将彻底改变AI计算格局。SK海力士预测,将HBM4引入客户系统后,AI服务性能最高可提升69%,这将从根本上解决数据瓶颈问题。

新一代AI加速器将极大受益于HBM4的高带宽特性。NVIDIA下一代Rubin架构GPU预计将集成288GB HBM4内存,而AMD Instinct MI400系列更将内存容量推升至432GB,配合19.6TB/s的带宽,可满足超大规模AI模型的运算需求。

数据中心运营成本也将显著降低。随着AI计算需求爆炸式增长,数据中心电力消耗已成为巨大负担,HBM4在提升性能的同时降低能耗的特性,正好解决了这一痛点。

04 市场定位:价格溢价反映技术价值

随着性能大幅提升,HBM4的价格也相应提高。据报道,SK海力士上半年从NVIDIA获得的HBM4 12层产品单价在500美元左右,比当时售价300美元的HBM3E 12层产品贵了60-70%。

价格上升的原因包括:HBM4将逻辑电路和半导体集成在一个封装中,设计和工艺难度提高;基础芯片采用了4nm工艺,SK海力士采用台积电的4nm工艺量产,成本约为一般DRAM的两倍;作为数据移动路径的输入/输出端子(I/O)数量与上一代相比增加了一倍以上,这也增加了制造成本。

虽然价格较高,但HBM4带来的性能提升使得其性价比仍然具有竞争力。对于需要处理海量数据的AI应用来说,投资更高性能的内存可以在整体系统成本上获得回报。

产业影响:重塑AI硬件生态

HBM4的量产将对整个AI硬件生态产生深远影响。其超高的带宽和容量特性,不仅能加速大语言模型的训练效率,还将为自动驾驶、科学计算等需要实时处理海量数据的领域提供关键支持。

对于芯片开发商而言,HBM4的高性能为他们提供了更广阔的设计空间。大多数开发商希望有一些储备性能以获得更多的安心,这意味着即使当前系统可能无法完全利用HBM4的全部性能,但随着技术发展,这种性能储备将变得有价值。

随着主要厂商陆续完成技术布局,2025年有望成为HBM4内存的商用元年。这将推动AI硬件进入全新发展阶段,为全球数字经济提供更强大的算力基础。

SK海力士全球率先完成HBM4开发并构建量产体系,标志着人工智能内存技术进入新时代。HBM4凭借带宽翻倍、能效提升40%以上的显著优势,将成为突破AI基础设施限制的核心产品,为下一代AI应用提供强大动力。

随着AI计算需求的持续增长,高性能内存的重要性日益凸显。SK海力士通过此次技术突破,进一步巩固了其在AI存储器领域的领导地位,但也面临着三星、美光等竞争对手的紧追不舍。未来几年,HBM4技术将成为AI算力竞争的关键战场,推动整个行业向更高性能、更低能耗的方向发展。

免责声明:本文为转载文章,转载此文目的在于传递更多信息,版权归原作者所有。本文所用视频、图片、文字如涉及作品版权问题,请联系小编进行删除。